Cẩn trọng với chiêu thức lừa đảo mới

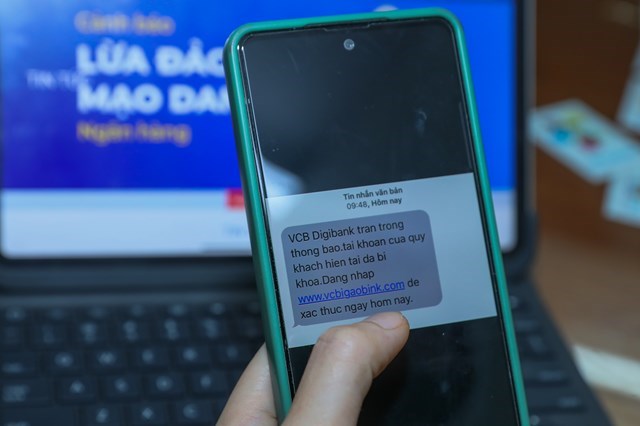

Theo các cơ quan chức năng, tội phạm đang triệt để lợi dụng sự phát triển của công nghệ để lừa đảo. Thay vì chỉ nhắn tin, gọi điện giả danh các nhân viên công vụ, người thân, các đối tượng còn sử dụng công nghệ AI, giả cả giọng nói, khuôn mặt của những người thân để gọi video, lừa đảo chiếm đoạt tài sản.

- 23-06-2023Nguy cơ lộ lọt thông tin từ việc tận dụng ChatGPT để tối ưu hóa công việc

- 23-06-2023Những chính sách mới đáng chú ý của Luật Giao dịch điện tử (sửa đổi) vừa được Quốc hội thông qua

- 23-06-2023Cảnh báo chiêu lừa đảo mới: Mạo danh công an kích hoạt tài khoản định danh điện tử

Nhiều ngân hàng khuyến cáo khách hàng cần nâng cao cảnh giác với các cuộc gọi lừa đảo. Ảnh: Quang Vinh.

Mức độ lừa đảo tăng lên

Công nghệ Deepfake (tạm dịch: Siêu làm giả) đã xuất hiện từ lâu nhưng gần đây lại nổi lên vì có nhiều nạn nhân đã bị lừa bởi ứng dụng này. Deepfake cho phép gán khuôn mặt của một người này sang một người khác trong video với độ chính xác cao. Những kẻ lừa đảo đã lợi dụng các ứng dụng Deepfake để làm ra các clip có nội dung lừa đảo, mạo danh. Nhiều người đã bị mất tiền do lầm tưởng là người thân, đồng nghiệp, lãnh đạo... gọi cho mình nhờ chuyển một khoản tiền cho họ.

Ngân hàng TMCP Hàng hải Việt Nam (MSB) vừa đưa ra khuyến cáo khách hàng về thủ đoạn lừa đảo sử dụng công nghệ Deepfake - công nghệ ứng dụng trí tuệ nhân tạo (AI) làm giả cuộc gọi video, với mục đích lấy dữ liệu khuôn mặt của khách hàng để dùng những dữ liệu này mở tài khoản tại ngân hàng.

Nhiều ngân hàng cũng đã khuyến cáo khách hàng cần nâng cao cảnh giác với các cuộc gọi giới thiệu là nhân viên của cơ quan nhà nước hoặc người quen, đặc biệt là các yêu cầu thực hiện các hành động lạ như: nhìn thẳng, nhìn sang trái, nhìn lên, nhìn xuống. Đồng thời, không cung cấp thông tin cá nhân như: số điện thoại, số CMT/CCCD, địa chỉ cho bất kỳ ai không quen biết hoặc chưa rõ mục đích sử dụng. Trong trường hợp nghi ngờ bị lừa đảo, khách hàng cần báo ngay cho cơ quan chức năng tại địa chỉ https://canhbao.ncsc.gov.vn hoặc báo lên Dự án chống lừa đảo: https://chongluadao.vn

Hiện nay, một trong những thủ đoạn mới đó là giả giọng nói, khuôn mặt của người thân bị hại để gọi điện bằng hình ảnh lừa đảo. Thủ đoạn của các đối tượng lừa đảo là lấy những video của người dùng đã đưa lên các nền tảng mạng xã hội, từ đó cắt ghép hoặc dùng công nghệ Deepfake, AI để thực hiện hành vi lừa đảo.

Một trong những nạn nhân bị lừa với thủ đoạn trên là chị V.T.M., trú quận Long Biên, TP Hà Nội. Theo lời kể của chị M., vào một buổi sáng, khi mở facebook, chị V.T.M., nhận được tin nhắn của một người bạn thân đang sinh sống ở nước ngoài hỏi chuyển nhờ số tiền 75 triệu đồng vào tài khoản. Nghĩ bạn cần, nên chị M. đã không ngại ngần chuyển tiền theo hướng dẫn.

Bản thân chị M. cũng cho biết, khi nhận được tin nhắn của bạn hỏi vay tiền, chị còn cẩn thận gọi video lại để kiểm tra thì có thấy hình ảnh của người bạn. Đến tối, trên trang facebook cá nhân của người bạn đăng dòng thông báo việc bị kẻ gian chiếm tài khoản facebook rồi hỏi vay tiền bạn bè, chị M. có gọi điện lại thì người bạn này xác nhận đã bị kẻ gian chiếm đoạt tài khoản mạng xã hội và dùng công nghệ AI cắt ghép hình ảnh, giọng nói để lừa đảo.

Một nam thanh niên ở quận 12, TPHCM cho biết, anh cũng nhận được cuộc gọi video call từ một người giả mạo người thân. Sau cuộc gọi đó, một ví điện tử trên sàn thương mại điện tử đã được mở với tên của mình dù không hề đăng ký.

Anh này cho biết không hiểu vì sao họ vào được tài khoản của sàn thương mại điện tử mà mình hay dùng để mua sắm rồi tạo hẳn một ví điện tử trên đó, tài khoản ngân hàng liên kết ví là của một ai đó, không phải của tôi.

Cần quy định pháp luật về bảo vệ dữ liệu cá nhân

Theo cảnh báo từ giới chuyên gia, tội phạm lừa đảo công nghệ cao là tội phạm ẩn, không tiếp xúc. Chính vì vậy, nếu liên quan đến tiền, vay mượn, chuyển khoản, người dân cần hết sức cảnh giác. Trong những trường hợp này, hãy xác minh, gặp gỡ trực tiếp, thông báo ngay cho cơ quan Công an để tránh bị sa vào bẫy lừa của các đối tượng.

Công an TPHCM mới đây cũng đã khuyến cáo, các đối tượng lừa đảo sẽ gọi video call, sau đó sử dụng nhiều thủ đoạn yêu cầu nạn nhân nhìn thẳng, nghiêng trái, nghiêng phải… để lấy hình ảnh của nạn nhân. Sau đó vượt qua thủ tục KYC (định danh cá nhân - một thủ tục quét khuôn mặt của người dùng) để kích hoạt và mở tài khoản ngân hàng, ví điện tử bằng hình thức online. Tài khoản ngân hàng, ví điện tử này có thể được sử dụng vào mục đích lừa đảo hoặc các hành vi vi phạm pháp luật, nạn nhân sẽ trở thành người liên quan vì là chủ tài khoản.

Theo ông Trần Minh Quảng - Giám đốc Trung tâm Phân tích và Chia sẻ nguy cơ an ninh mạng (Viettel Cyber Security), các cuộc tấn công của tin tặc sẽ ngày càng nguy hiểm, tinh vi đến từ các tổ chức được đào tạo chuyên nghiệp, cùng tiềm lực tài chính dồi dào, đủ khả năng thực hiện những vụ việc có quy mô lớn. Những doanh nghiệp cung cấp dịch vụ cho người dùng cuối cần đẩy mạnh các biện pháp phòng, chống tấn công cho chính bản thân cũng như khách hàng, nhất là tổ chức ngân hàng, tài chính.

Còn ông Nguyễn Ngọc Cương - Phó cục trưởng Cục An ninh mạng và phòng, chống tội phạm công nghệ cao (A05) cho rằng, để hạn chế tình trạng mua bán dữ liệu cá nhân đang diễn ra tràn lan hiện nay, cần phải hoàn thiện quy định pháp luật về bảo vệ dữ liệu cá nhân. Theo đó, hoạt động thu thập dữ liệu cá nhân phải được diễn ra công khai, minh bạch, có sự đồng ý của chủ thể cũng như dưới sự quản lý của Nhà nước. Không những thế, cần hình sự hóa những hành vi vi phạm về bảo vệ dữ liệu cá nhân. Bên cạnh đó, cũng cần tăng mức xử phạt hành chính với những hành vi dạng trên để đủ sức răn đe đối tượng vi phạm.

Đại đoàn kết